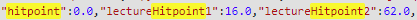

CNN(Convolutional Neural Network)이란 ? 이미지와 같은 2D 데이터를 처리하기 위한 딥러닝 모델이고, CNN은 Convolutional Layer, Pooling Layer, Fully Connected Layer 등으로 구성되어 있다. Convolutional Layer에서는 이미지같은 입력 데이터를 필터(kernel)와 합성곱 연산을 통해 다양한 feature를 추출하는 것이다. 합성곱 연산은 입력 데이터와 필터를 일정 간격으로 겹쳐가며 곱하고 더하는 연산이다. 이러한 연산을 통해 출력 데이터 크기를 계산할 수 있다. 공식은 위와 같다. 주의할 점은 입력 데이터의 채널 수와 kernel의 채널 수가 같아야 하는 것 ! parameter 개수 공식 : (kernel 가로*세로..